Le salon Documation est le rendez-vous incontournable des professionnels de la gestion de l’information et de la dématérialisation. Organisé chaque année à Paris Expo Porte de Versailles, il rassemble exposants et experts autour de thèmes aussi divers que le big data, la cybersécurité, la gestion de contenus et la transformation digitale des entreprises. Cette édition 2025 met une fois de plus l’accent sur l’intelligence artificielle, et en particulier sur l’intelligence artificielle (IA) générative, qui continue de susciter un vif intérêt.

Si l’IA est un sujet récurrent à Documation, il est essentiel de rappeler qu’elle ne date pas d’hier. Dès les années 1950, elle suscitait déjà autant d’enthousiasme que de craintes, oscillant entre science-fiction et promesses technologiques. Aujourd’hui, l’IA générative, capable de produire du texte, des images et du son, s’inscrit dans cette longue tradition d’innovation tout en posant de nouveaux défis en matière de sécurité et d’éthique. Et le débat est loin d’être clos : de nouvelles perspectives émergent, notamment avec le développement de l’intelligence artificielle quantique, qui associe la puissance des algorithmes quantiques à l’IA pour atteindre des performances inédites.

IA et gestion des risques : une table ronde riche en enseignements

Lors de ma visite au salon, j’ai assisté à une table ronde intitulée « Risques et opportunités des IA pour l’IT, les métiers et les clients ». Menée par Myriam Quemener, magistrate de la Cour d’appel de Paris, Anthony du Plantier, expert en gestion des risques et conformité ainsi que Léo Cohen, spécialiste en IA, cette discussion a permis d’aborder plusieurs enjeux actuels :

- Fraude et ingénierie sociale 2.0 : la fraude aux présidents, autrefois menée par téléphone ou par e-mail, s’est sophistiquée grâce aux deepfakes. Ces nouvelles techniques reposent sur une ingénierie sociale avancée pour tromper les interlocuteurs et dérober des informations sensibles.

- L’essor du shadow IA : poussés par la recherche d’efficacité, de nombreux collaborateurs utilisent des outils d’IA non autorisés – un phénomène connu sous le nom de shadow IA. Par exemple, des développeurs recourent à des IA génératives pour débuguer leur code en quelques heures au lieu de plusieurs jours. Si ce gain de productivité est indéniable, il soulève des risques majeurs liés à la protection des données sensibles.

- L’empoisonnement des modèles IA : encore peu médiatisé, ce risque consiste à corrompre les bases de données qui alimentent les IA. Des acteurs malveillants peuvent introduire des données biaisées ou erronées, faussant ainsi les résultats et compromettant la fiabilité des décisions automatisées.

Face à ces menaces, plusieurs mesures sont essentielles pour sécuriser l’usage de l’IA en entreprise :

- Sensibiliser les employés aux risques liés à l’usage de l’IA et aux techniques de fraude.

- Mettre en place une gouvernance stricte des données pour protéger les informations sensibles.

Créer une charte IA qui encadre l’utilisation des outils d’intelligence artificielle de manière sécurisée.

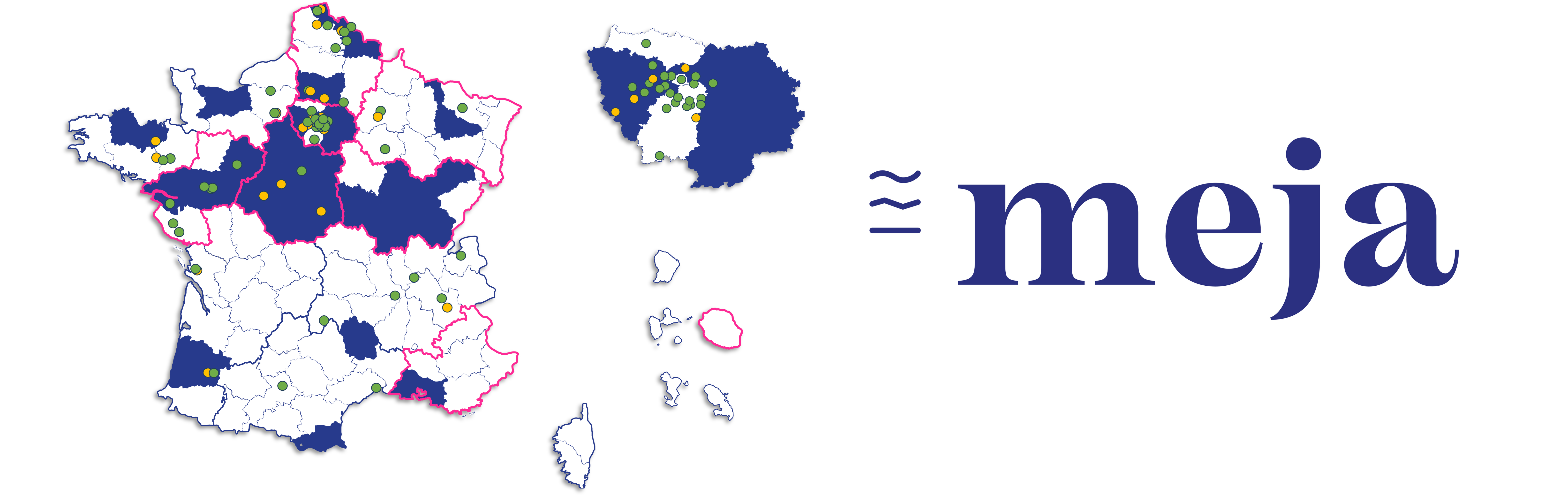

Chez meja, une approche globale pour une IA responsable

Notre expertise en dématérialisation des processus et en gestion documentaire nous amène naturellement à nous approprier ces sujets, qui sont au cœur de nos méthodes. Ce type d’évènements est une véritable mine d’or, car ces questions sont au centre des préoccupations de nos clients, et ils nous offrent l’opportunité d’observer de près les évolutions du secteur.

Nous observons d’ailleurs que l’IA générative prend une place croissante dans nos missions. C’est pourquoi nous l’abordons sous plusieurs angles :

- Cadrage du besoin : définir pourquoi intégrer l’IA dans un projet, comprendre ses implications et identifier les objectifs visés.

- Mise en place d’une gouvernance adaptée : définir des règles internes claires et assurer une conformité réglementaire avec le RGPD et l’IA Act.

- Intégration et interopérabilité : assurer une adoption fluide en intégrant l’IA aux outils et processus existants.

- Accompagnement au changement : former les équipes et adapter les processus pour maximiser l’adoption de l’IA tout en maîtrisant les risques.

- Amélioration continue : mettre en place des indicateurs de performance pour évaluer l’impact de l’IA et ajuster les pratiques en fonction des retours et des évolutions technologiques.

La réflexion autour de l’IA devient centrale dans nos organisations, et toutes les entreprises travaillent aujourd’hui à la mise en œuvre d’un stratégie IA. Chez meja, par exemple, nous travaillons actuellement à l’élaboration d’une charte d’utilisation de l’IA générative pour encadrer son usage de manière responsable et sécurisée.

Mais comment aborder ce virage ? S’agit-il d’une véritable rupture ou, au contraire, d’une continuité dans l’évolution de nos pratiques ?

Gouvernance de l’information et IA : une continuité plutôt qu’une rupture

Notre conviction est que la gestion de l’information et des données par le risque repose avant tout sur l’identification des informations sensibles, l’évaluation du niveau de risque (sécurité, non-disponibilité, divulgation ou même sur-conservation) et l’adaptation des processus en conséquence. Mon expérience en gouvernance de l’information m’a appris que ces enjeux ne sont pas nouveaux : ils ont toujours été au cœur de notre métier.

Ce qui se passe aujourd’hui avec l’IA générative n’est donc pas une révolution qui remet en cause notre méthodologie, mais une évolution des problématiques classiques. Il s’agit toujours de comprendre, mesurer et maîtriser le risque lié à une donnée sensible.

Si vous voulez vous lancer dans une stratégie IA, voici les trois règles essentielles à garder en tête :

- Définissez les cas d’usage généraux, c’est-à-dire la finalité propre et l’usage opérationnel de votre IA. C’est sur cette base uniquement que seront développés les systèmes d’IA et c’est sur cette base que vous pourrez savoir quand et comment utiliser l’IA dans votre secteur.

- Cartographiez vos données avant d’adopter une IA : quelles sont les informations les plus critiques ? Lesquelles ne doivent en aucun cas être exposées à des modèles externes ? Sans vision claire de votre patrimoine informationnel, difficile de maîtriser les risques.

- Encadrez les usages pour éviter le “shadow IA” : si vos collaborateurs utilisent déjà l’IA générative sans cadre, vous perdez en contrôle et en sécurité. Mettez en place des règles claires et accompagnez leur adoption plutôt que de subir un usage incontrôlé.

Loin d’être une simple tendance, l’IA est un véritable levier de transformation, à condition qu’elle soit maîtrisée, sécurisée et intégrée avec méthode. C’est dans cette optique que nous accompagnons nos clients, en veillant à concilier innovation – fidèle à notre devise « Never Stop Learning » – et maîtrise des risques.

Camille Guyonnet – Consultante senior chez meja